TL;DR

Private KI-Infrastruktur für Unternehmen bedeutet, dass Modellbetrieb, Inferenz, Speicher und Protokolle in einer Plattform unter deiner Kontrolle laufen, statt in der Multi-Tenant-Umgebung eines externen Anbieters. Drei Deploymentpfade sind gängig: verwaltete Private Cloud (schnell, dedicated), hybrid (Steuerebene in der Cloud, sensitive Inferenz im Haus) und on-premise (komplett eigene Hardware). Jede Variante hat eine eigene Kosten- und Governance-Logik.

Warum private KI-Infrastruktur jetzt?

Die Nutzungsfrage verschiebt sich. Nicht mehr: “Reicht uns ein Chatbot?” sondern: “Welche unserer Dokumente, Mandantendaten, Risikoinformationen dürfen wir überhaupt in ein externes Modell geben?” Für Family Offices, Steuerberatungskanzleien und Spezialmakler lautet die ehrliche Antwort oft: nicht viele. Und für viele Use Cases, die produktive Zeit sparen (Reportingauswertung, Belegverarbeitung, Wording-Vergleich), sind externe Cloud-Modelle entweder nicht zulässig oder nur mit erheblichem Vertragsaufwand einsetzbar.

Private KI-Infrastruktur löst dieses Spannungsfeld, indem sie den Modellbetrieb so nah an deine Daten rückt, wie du es brauchst, ohne dass dein Team in den täglichen Betrieb einer GPU-Flotte eingebunden wird.

Was ist private KI-Infrastruktur?

Private KI-Infrastruktur ist eine dedizierte Plattform, in der ein Sprachmodell (typischerweise Open-Weight wie Llama, Mistral oder Qwen) unter deiner Kontrolle läuft. Die Umgebung umfasst in der Regel: Modell-Serving (z. B. vLLM), Vektorspeicher für Retrieval (z. B. Qdrant oder pgvector), Rollenmodell, Logging, Monitoring und Update-Runbook. Das Modell verarbeitet deine Daten zur Laufzeit und gibt keine Inhalte an externe Modellanbieter weiter.

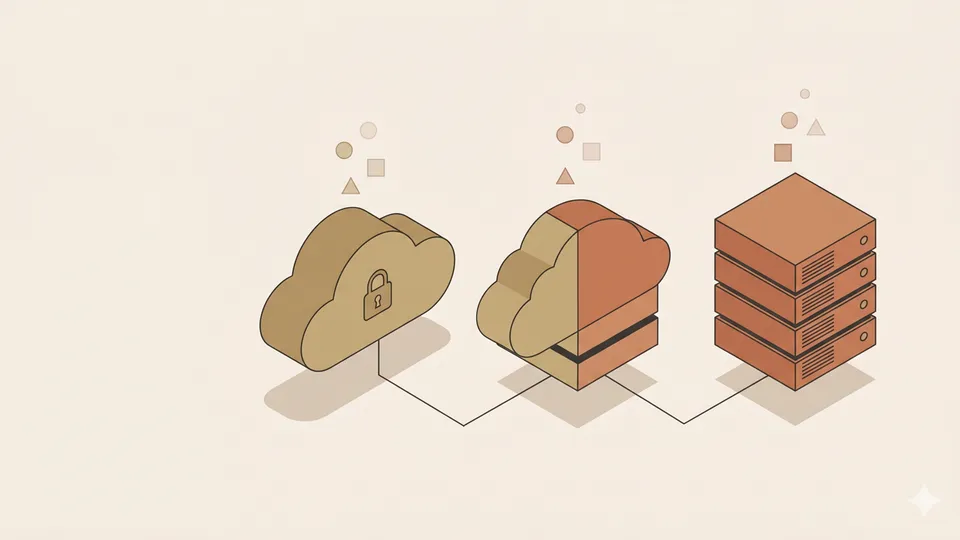

Drei Deploymentpfade

Verwaltete Private Cloud. Die Plattform läuft in einem zertifizierten deutschen Rechenzentrum in dedizierter Ausgestaltung, unter Verwaltung eines Partners (z. B. abi consulting). Kein eigener Serverkauf, keine eigene GPU-Pflege. Projektstart 2 bis 4 Wochen. Laufende Infrastrukturkosten werden separat ausgewiesen.

Hybrid. Steuerebene und Vektorspeicher laufen in der Cloud, sensitive Inferenz und Protokolle auf deiner eigenen Hardware im Rechenzentrum. Geeignet, wenn du bereits eigene Server hast, aber GPU-Kapazität flexibel halten willst. Projektstart 4 bis 6 Wochen, zzgl. Hardwarebudget.

On-Premise. Komplette Plattform auf deiner eigenen Hardware. Inferenz, Speicher und Protokolle liegen vollständig im Haus. Höchste Kontrolle, längerer Start (6 bis 8 Wochen zzgl. Hardwarebeschaffung). Laufende Kosten sind deine Betriebs- und Wartungskosten.

Kostenlogik

Projektpreis und laufende Infrastruktur werden getrennt ausgewiesen. Der Projektpreis deckt Aufbau der Plattform, einen Prozess, Rollenmodell und Betriebsakte. Die laufende Infrastruktur besteht aus GPU-Laufzeit, Speicher, Netzwerk und Monitoring. Hardware ist bei Hybrid und On-Premise ein separates Budget. Genaue Bänder stehen auf der Private-KI-Start-Seite.

Governance und AI-Act-Relevanz

Unabhängig vom Deploymentpfad verlangt datenschutzkonforme KI dokumentierte Datenflüsse, ein Rollen- und Freigabemodell, Logging und eine AI-Act-Einordnung je Workflow. Der AI Act verpflichtet in Artikel 4 zu ausreichender KI-Kompetenz beim eingesetzten Personal, unabhängig vom Deployment. Wir behandeln diese Aspekte ausführlicher in Datenschutzkonforme KI für Kanzleien und Family Offices und EU AI Act Schulungspflicht.

Für wen welcher Pfad?

- Family Offices mit Fokus auf schnelle Entlastung der Analysten und ohne eigene Serverinfrastruktur starten typischerweise in der verwalteten Private Cloud. Vertiefung: Eigene KI für Family Offices.

- Steuerberatungskanzleien mit strengen berufsrechtlichen Anforderungen wählen häufig hybrid oder on-premise. Vertiefung: Datenschutzkonforme KI für Steuerberater.

- Spezial- und Industriemakler mit sensiblen Wording- und Risikodatenbeständen entscheiden nach Marktvolumen und bestehender Serverlandschaft. Vertiefung: Eigene KI für Versicherungsmakler.

Wie du startest

Zwei typische Wege: Wer zuerst Klarheit über Priorisierung und Governance braucht, bucht das KI-Workflow-Audit, ein kostenloses 30-Minuten-Erstgespräch mit erster Einschätzung und klarer Empfehlung. Die detaillierte Priorisierung nach Aufwand, Nutzen und Datenschutzlage sowie der Rolloutplan laufen anschließend in Phase 0 des Private-KI-Start. Wer den Prozess bereits priorisiert hat, geht direkt in den Private-KI-Start.

Häufige Fragen

Was unterscheidet verwaltete Private Cloud von SaaS-KI? Bei verwalteter Private Cloud läuft die Plattform in einer dedizierten Ausgestaltung ohne Modelltraining durch Dritte. Bei SaaS-KI teilst du dir die Infrastruktur mit anderen Mandanten und die Datenverarbeitung unterliegt den AGB des Anbieters.

Wie lange dauert der Aufbau? 2 bis 8 Wochen je nach Deployment (Private Cloud 2 bis 4, Hybrid 4 bis 6, On-Premise 6 bis 8 zzgl. Hardwarebeschaffung).

Bleibt Copilot oder ChatGPT trotzdem eine Option? Für viele Standardfälle ja. Microsoft 365 Copilot und OpenAI Business/Enterprise/API trainieren Geschäftsdaten per Default nicht. Für besonders sensible Daten ergänzt private KI-Infrastruktur diese Tools gezielt.

Gespräch vereinbaren

Wir klären in 30 Minuten, welcher Deploymentpfad zu deinen Datenklassen, deiner Serverlandschaft und deinem Zeitplan passt. Erstgespräch vereinbaren.